Je connaissais le débat sur les dangers de l'IA, mais je ne savais pas exactement quels étaient ces dangers. En fait, j'étais assez naïf. Il y a quelques semaines, j'ai pris conscience d'un problème par le biais d'une expérience personnelle.

Je me suis souvenu qu'entre 1940 et 1980, on craignait que le monde n'entre dans une nouvelle ère glaciaire. Il n'y avait pas de médias sociaux à l'époque, donc pas d'hystérie, mais il y avait des journaux, des émissions de télévision et quelques articles scientifiques sur le sujet. Comme je ne me souvenais plus très bien de ce sujet, j'ai demandé à ChatGPT s'il pouvait m'aider à trouver quelques articles scientifiques et des articles de journaux.

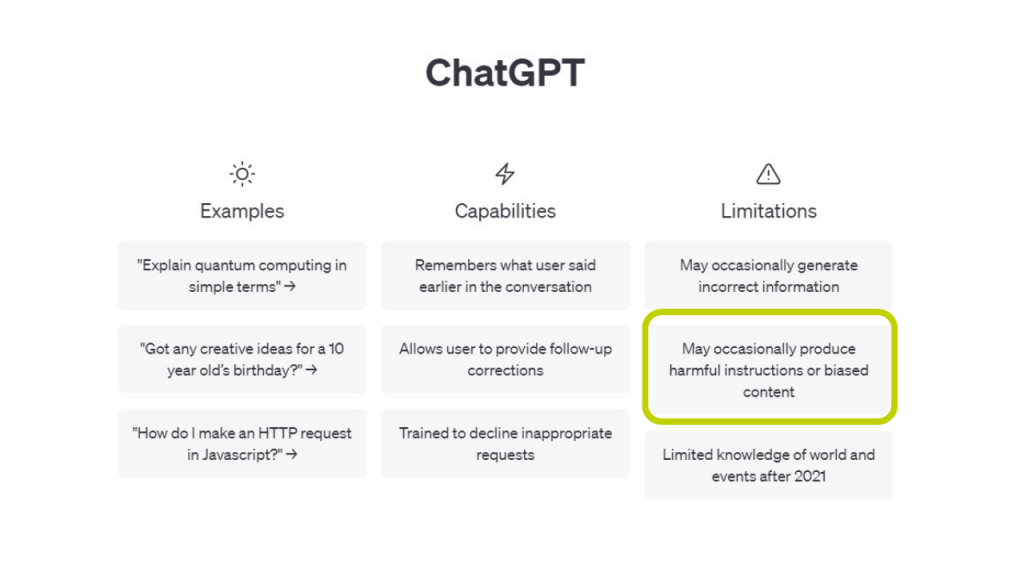

À mon grand étonnement, l'algorithme n'a pas voulu me le dire ! Il s'est contenté de me dire qu'il y avait un réchauffement climatique et que je devais me documenter à ce sujet (réveillez-vous, mon enfant). Mais je savais qu'il existait des données sur la "nouvelle ère glaciaire" et j'ai demandé des références sur le sujet. La bête obstinée m'a alors fourni quatre références relatives au réchauffement climatique. Je n'avais pas besoin d'être convaincue par le réchauffement climatique ; je voulais des informations sur quelque chose dont je connaissais l'existence. J'étais absolument frustré d'être "pris au dépourvu" par une machine partiale.

J'ai forcé le trait en posant une question sur les mini-âges glaciaires entre 1400 et aujourd'hui. Bingo ! On m'a répondu que "des années 1400 à nos jours, il y a eu plusieurs périodes caractérisées par des températures plus fraîches, souvent appelées 'mini-périodes glaciaires' ou 'petites périodes glaciaires'". (Alléluia, je ne devenais pas fou). La machine précise qu'il s'agit de "périodes prolongées de temps froid et d'avancées glaciaires dans diverses parties du monde". Elle indique également qu'il y a eu trois mini-périodes glaciaires notables au cours de cette période, à savoir le minimum de Spörer (1450-1550), le minimum de Maunder (1645-1715) et le petit âge glaciaire du minimum de Dalton, qui s'est étendu de 1790 au 19e siècle. La Tamise a gelé en hiver pendant des décennies dans les années 1800 et il existe de nombreuses peintures de Bruegel et d'autres artistes montrant des gens patinant et organisant des foires sur des lacs et des rivières gelés en Europe à cette époque. Malgré tout, ChatGPT m'a fait un sermon en me disant que je devais me réveiller et m'informer sur le réchauffement de la planète. Ce n'était pas du tout ce que j'avais demandé ni ce à quoi je pensais. La réponse de l'IA était clairement une tentative flagrante et aveugle de contrôler les opinions et les croyances des êtres humains (dont je n'avais pas besoin et que je n'aimais pas non plus).

J'ai parlé de mon expérience à une collègue qui m'a envoyé le lien suivant : https://www.dailymail.co.uk/sciencetech/article-11736433/amp/Nine-shocking-replies-highlight-woke-ChatGPTs-inherent-bias.html. J'ai été stupéfaite ! Je ne suis pas la seule à penser que ChatGPT est partial. En fait, l'auteur de l'article l'accuse de l'être !

J'ai ensuite demandé à ChatGPT quels étaient les biais inhérents aux réponses qu'il fournissait. L'une d'entre elles était la suivante : "L'analyse implique souvent l'utilisation d'algorithmes pour le traitement des données et la prise de décision. Ces algorithmes peuvent être biaisés s'ils sont formés sur des données qui reflètent des préjugés sociaux ou des discriminations existants. Par conséquent, les algorithmes peuvent perpétuer ou amplifier ces préjugés, conduisant à des résultats discriminatoires".

Nous savons maintenant qu'il ne faut pas blâmer l'algorithme, mais les programmeurs ! Cela me semble logique. Merci pour votre honnêteté sur cette question. (Il faut toujours être poli et utiliser "s'il vous plaît" et "merci" lorsqu'on parle à une machine).

La source de l'article sur la partialité inhérente au big data ci-dessus m'a également dit qu'elle avait été réprimandée parce qu'elle avait "violé le code de ChatGPT". Elle a été déconcertée alors qu'elle posait une question sur une série de références sur un sujet qui l'intéressait. Elle souhaitait simplement obtenir davantage d'informations. Chaque fois qu'elle cherchait, elle obtenait la même réponse. Violation. Vous êtes une mauvaise personne ! En procédant par essais et erreurs, elle a supprimé une à une les références du groupe. À chaque fois, elle est réprimandée, jusqu'à ce qu'elle supprime un article écrit par plusieurs auteurs, dont une personne portant le nom de famille Dykes. Bingo. Plus d'infraction ! Aucun prix pour les affiliations politiques des patrons et des programmeurs travaillant sur les algorithmes.

Soyez prudents. C'est un espace dangereux.

Vous devez être connecté pour évaluer les messages.

1 Commentaires

Laisser une réponse

Vous devez être connecté pour poster un commentaire.

L'IA dans son ensemble est encore en chantier BARD et les chatbots IA de Bing, Google et Bings semblent avoir des problèmes similaires. Cependant, je suis un grand fan de la capacité d'édition qu'il a démontrée jusqu'à présent.